Information som skickas till ChatGPT i tron att den är anonym kan ändå klassas som personuppgift och falla under GDPR:s fulla tillämpningsområde. Det är en insikt som många organisationer saknar när de börjar använda AI-tjänster i sin dagliga verksamhet. Kombinationer av jobbroll, e-postformat och arbetsrelaterad kontext räcker ofta för att skapa ett indirekt identifierbart mönster. Den här guiden ger jurister och dataskyddsspecialister en konkret genomgång av de juridiska kraven, de tekniska riskerna och de praktiska stegen för att hantera personuppgifter i ChatGPT på ett lagligt och strukturerat sätt.

Innehållsförteckning

-

Juridiska krav och regulatoriska risker vid ChatGPT-användning

-

Tekniska och praktiska risker vid hantering av personuppgifter i ChatGPT

-

Vår syn: Vad de flesta missar om personuppgifter och AI-tjänster

Viktiga Insikter

| Punkt | Detaljer |

|---|---|

| Ange aldrig persondata i gratisversion | Gratis- och konsumentversionen av ChatGPT saknar GDPR-skydd och tillåter inte biträdesavtal. |

| Riskanalys före AI-introduktion | All behandling av personuppgifter i AI-tjänster kräver riskbedömning enligt IMY:s rekommendationer. |

| Tänk på metadata | Ip-adress, tid och andra metadata kan göra till synes anonym data identifierbar. |

| Välj företags- eller Enterprise-lösning | Endast affärsversioner kan tillhandahålla biträdesavtal och EU-dataresidens. |

Vad är en personuppgift i AI-sammanhang?

Det finns en utbredd uppfattning att en personuppgift kräver ett namn eller ett personnummer för att vara skyddsvärd. Den uppfattningen är felaktig och kan leda till allvarliga misstag när organisationer börjar använda AI-verktyg som ChatGPT. Enligt GDPR är en personuppgift all information som direkt eller indirekt kan kopplas till en levande fysisk person.

Direkta identifierare är relativt enkla att känna igen:

-

Fullständigt namn

-

Personnummer eller ID-nummer

-

E-postadress

-

Telefonnummer

-

Fysisk adress

Men de indirekta identifierarna är mer svårfångade och ofta förbisedda i AI-sammanhang:

-

Jobbtitel kombinerad med arbetsplats och ort

-

E-postformat (t.ex. fornamn.efternamn@foretag.se)

-

IP-adress

-

Kombinationer av ålder, kön och geografisk plats

-

Beskrivningar av specifika arbetsuppgifter eller ärenden som pekar ut en person

“Att mata in personuppgifter i ChatGPT utgör personuppgiftsbehandling enligt GDPR, vilket kräver laglig grund, biträdesavtal för personuppgiftsbiträden och efterlevnad av principer som dataminimering.”

Det är viktigt att förstå att principen om dataminimering inte bara handlar om att undvika namn. Den handlar om att inte behandla mer information än vad som är nödvändigt för ändamålet. Om en anställd matar in ett detaljerat ärende om en kund för att få hjälp med formuleringar, är det med stor sannolikhet en personuppgiftsbehandling, även om kundens namn aldrig nämns.

Gränsdragningen är svår i praktiken. En prompt som beskriver “en 58-årig manlig patient på en specifik avdelning med en sällsynt diagnos” är identifierbar för den som känner till kontexten. Detsamma gäller en beskrivning av “vår HR-chef i Malmö som hanterade ett specifikt disciplinärende förra månaden.” Dessa kombinationer skapar unika fingeravtryck.

Organisationer som arbetar med AI-förordningen och GDPR parallellt behöver etablera tydliga kriterier för när information klassas som personuppgift i AI-kontext, och dessa kriterier måste kommuniceras till all personal som använder AI-verktyg.

Juridiska krav och regulatoriska risker vid ChatGPT-användning

När du nu känner de rättsliga ramarna, är nästa logiska steg att noggrant utvärdera och dokumentera risker innan introduktion av AI-tjänster. Skillnaderna mellan de olika versionerna av ChatGPT är avgörande ur ett GDPR-perspektiv och förstås inte alltid av de som fattar beslut om AI-implementering.

| Version | Biträdesavtal | Träning på data | EU-lagring | GDPR-lämplig |

|---|---|---|---|---|

| ChatGPT Free | Nej | Ja (standard) | Nej | Nej |

| ChatGPT Plus | Nej | Kan stängas av | Nej | Tveksamt |

| ChatGPT Team | Ja | Nej | Nej | Delvis |

| ChatGPT Enterprise | Ja | Nej | Ja (valbart) | Ja |

Tredjelandsöverföring är ett kritiskt område. ChatGPT innebär överföring till amerikanska servrar, vilket kräver standardavtalsklausuler (SCC) och en kompletterande konsekvensbedömning för tredjelandsöverföring (TIA) efter Schrems II. Enterprise-versionen erbjuder EU-dataresidens som en möjlig åtgärd.

En TIA är inte en standardmall. Den kräver en faktisk analys av det tredje landets lagstiftning, risken för myndighetstillgång och om de tekniska och organisatoriska åtgärderna är tillräckliga. Det är ett arbete som kräver juridisk kompetens och dokumentation.

De flesta organisationer glömmer att kontrollera om deras befintliga personuppgiftspolicy och registerförteckning täcker AI-verktyg. Lägg till ChatGPT som ett separat behandlingsmoment med tydlig rättslig grund, ändamål och biträdesrelation. Se också till att böter vid saknat biträdesavtal inte drabbar din organisation genom att granska avtalsläget innan ni börjar använda tjänsten.

En konsekvensbedömning enligt GDPR bör genomföras tidigt i processen, inte som en efterhandskontroll.

Riskbedömning och konsekvensanalys: DPIA och TIA vid AI

Med struktur för riskbedömning på plats bör organisationer också förstå riskerna kopplade till informationsflödet i själva AI-tjänsten. En Data Protection Impact Assessment (DPIA), på svenska konsekvensbedömning avseende dataskydd, är obligatorisk vid behandling som sannolikt medför hög risk för fysiska personers rättigheter och friheter.

DPIA krävs vid högrisksbehandling som behandling av känsliga uppgifter eller storskalig användning i ChatGPT. IMY rekommenderar riskanalys innan AI-tjänster implementeras.

Praktiska steg för att genomföra en DPIA och TIA vid AI-projekt:

-

Kartlägg behandlingen. Identifiera exakt vilka personuppgifter som kan komma att matas in, av vem och i vilket syfte. Inkludera indirekta identifierare.

-

Bedöm nödvändighet och proportionalitet. Kan ändamålet uppnås utan att personuppgifter behandlas? Är behandlingen proportionerlig mot syftet?

-

Identifiera risker. Lista konkreta risker: obehörig åtkomst, träning på känslig data, svårighet att radera, tredjelandsöverföring.

-

Bedöm skyddsåtgärder. Vilka tekniska och organisatoriska åtgärder finns? Räcker de för att reducera riskerna till en acceptabel nivå?

-

Genomför TIA. Analysera det mottagande landets lagstiftning, myndigheters tillgång till data och om SCC är tillräckliga skyddsåtgärder.

-

Dokumentera och godkänn. DPIA ska dokumenteras och i vissa fall konsulteras med tillsynsmyndigheten IMY innan behandlingen påbörjas.

| Risk | Sannolikhet | Konsekvens | Motåtgärd |

|---|---|---|---|

| Träning på känslig data | Hög (free) | Hög | Använd Enterprise, avaktivera träning |

| Tredjelandsöverföring | Hög | Medel-hög | SCC + TIA, EU-dataresidens |

| Saknat biträdesavtal | Hög (free/plus) | Hög | Byt till Team/Enterprise |

| Metadata-identifiering | Medel | Medel | Anonymisering, minimering |

| Anställda delar data utan policy | Hög | Hög | Interna riktlinjer, utbildning |

Proffstips: Metadata är en underskattad risk. En prompt innehåller inte bara texten du skriver. Den innehåller också tidsstämpel, IP-adress, sessionsinformation och kontokopplingar. Tredjelandsöverföring av metadata kan i kombination med andra uppgifter möjliggöra identifiering. Inkludera alltid metadata i din riskanalys, inte bara innehållet i prompten.

En grundlig steg-för-steg-konsekvensbedömning ger din organisation den dokumentation som krävs vid en eventuell tillsyn och skapar ett strukturerat underlag för beslutsfattande.

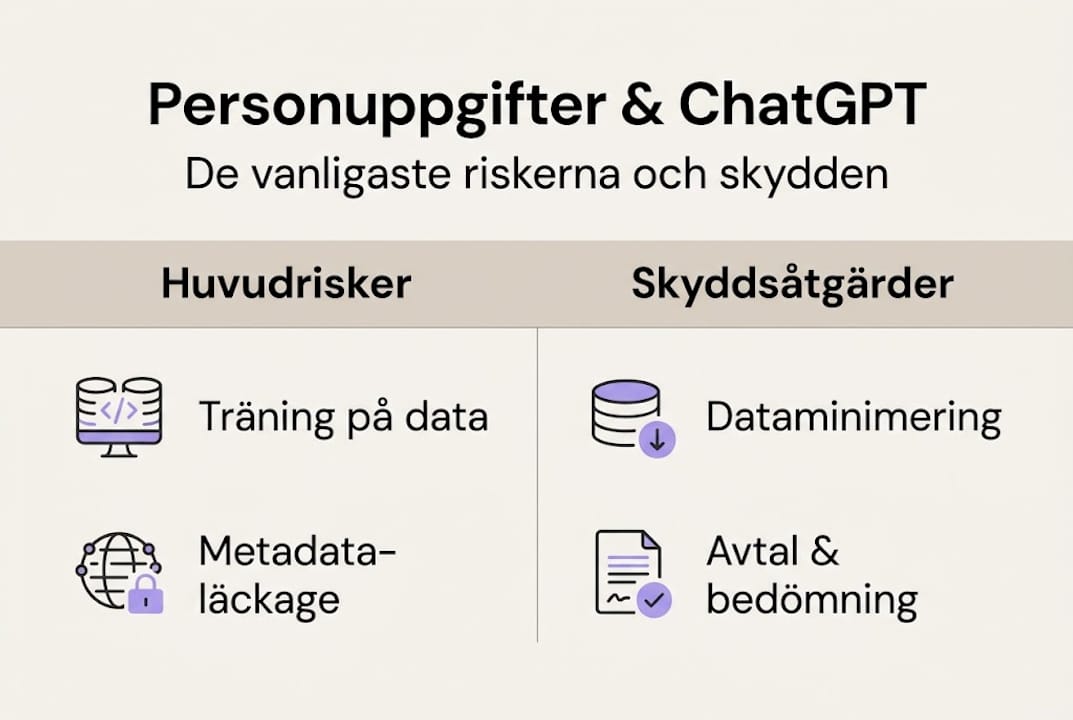

Tekniska och praktiska risker vid hantering av personuppgifter i ChatGPT

Nu när du har en bild av både tekniska och regulatoriska risker är det dags att konkretisera de specifika tekniska riskerna och hur de hanteras i praktiken. Det finns tre huvudsakliga tekniska riskområden som organisationer behöver förhålla sig till.

Träningsdata och svårigheten att radera. I gratisversionen av ChatGPT kan data som matas in användas för modellträning och är svår att radera efter att träningen skett. Promptar innehåller också metadata som IP-adress, vilket gör identifiering möjlig. Det är ett fundamentalt problem: när en personuppgift väl är inbäddad i en språkmodell finns det ingen teknisk mekanism för att selektivt radera den. Rätten till radering enligt GDPR artikel 17 kan i praktiken inte uppfyllas.

Metadata och oavsiktlig identifiering. Varje interaktion med ChatGPT genererar teknisk metadata. IP-adress, tidsstämpel, kontoinformation och sessionslängd är alla potentiella identifierare. Kombinerat med innehållet i prompten kan detta skapa ett mönster som möjliggör identifiering av individer, även om inga direkta personuppgifter skrivits in.

Anställdas informationsdelning utan policy. Det kanske mest underskattade riskområdet är det beteendemässiga. Anställda som använder ChatGPT för att effektivisera sitt arbete delar ofta arbetsrelaterad information utan att reflektera över om den innehåller personuppgifter. En HR-medarbetare som ber ChatGPT hjälpa till att formulera ett varningsbrev, en jurist som klistrar in delar av ett ärende för att få hjälp med juridisk argumentation, eller en chef som beskriver en medarbetarsituation för att få råd om ledarskap.

Praktiska åtgärder för att minimera riskerna:

-

Anonymisering före inmatning. Ersätt namn, roller och specifika detaljer med generiska beskrivningar. “En medarbetare på ekonomiavdelningen” istället för ett namn.

-

Dataminimering som standard. Inkludera aldrig mer information än vad som är absolut nödvändigt för att få hjälp med uppgiften.

-

Interna riktlinjer och utbildning. Etablera tydliga regler för vad som får och inte får matas in i AI-verktyg. Utbilda personal regelbundet.

-

Tekniska kontroller. Överväg DLP-lösningar (Data Loss Prevention) som kan identifiera och blockera känslig information innan den skickas till externa tjänster.

-

Versionsval baserat på risknivå. Använd Enterprise-versionen vid behandling av arbetsrelaterade uppgifter och se till att EU-dataresidens är aktiverat.

“IMY betonar att anställda ofta delar mer information än de avser när de använder AI-tjänster, eftersom gränsen för vad som är en personuppgift inte alltid är uppenbar i en arbetskontext.”

Kombinationen av tekniska skyddsåtgärder och tydliga interna riktlinjer är avgörande. Tekniken kan inte ensam lösa problemet med oavsiktlig datadelning.

Vår syn: Vad de flesta missar om personuppgifter och AI-tjänster

Den verkliga risken med personuppgifter i AI-tjänster är inte den organisation som medvetet väljer fel version av ChatGPT. Det är den organisation som tror att de har kontroll, men inte har det.

Vi ser ett återkommande mönster: juridik och IT har tagit fram riktlinjer, men de når inte ut till de anställda som faktiskt använder verktygen. En enskild medarbetare som ber ChatGPT hjälpa till att skriva ett e-postmeddelande om ett kundärende tänker inte på GDPR. Det är mänskligt och förståeligt. Men konsekvenserna är desamma som om beslutet fattats medvetet.

Regelverken är tydliga. Men den upplevda gråzonen är stor i praktiken, och det är just i den gråzonen som de flesta incidenter uppstår. Små, till synes oskyldiga datakombinationer kan ge stora följdproblem, som illustreras av fall om olagliga arbetsrelaterade personuppgifter i andra digitala sammanhang.

Det räcker inte med ett biträdesavtal och en DPIA. Organisationer behöver bygga en kultur där dataskydd är en naturlig del av arbetsflödet, inte en juridisk checklista som bockas av en gång om året.

Få stöd med dataskydd och compliance hos TrustView

Vill du undvika riskerna och skapa en robust strategi för AI och personuppgiftsbehandling?

TrustView erbjuder strukturerat stöd för organisationer som hanterar GDPR-efterlevnad vid AI-användning. Det inkluderar vägledning vid DPIA och TIA, granskning av biträdesavtal, policyutveckling och utbildning av personal. Med TrustViews plattform kan du samla riskbedömningar, behandlingsregister och åtgärdsplaner på ett ställe och säkerställa att ingenting faller mellan stolarna. Läs mer om hur du bygger en hållbar åtgärdsplan för compliance eller ta reda på varför TrustView är rätt partner för din organisations dataskyddsarbete.

Vanliga frågor och svar

Är det någonsin tillåtet att lägga in personuppgifter i ChatGPT?

Ja, men endast om du har ett giltigt biträdesavtal, rätt laglig grund och uppfyller kravet på dataminimering enligt GDPR. I praktiken innebär det att du behöver använda ChatGPT Team eller Enterprise.

Vad är den största tekniska risken med att använda ChatGPT för arbetsuppgifter?

Data du matar in kan sparas som träningsdata och är svår att radera i efterhand. Promptar innehåller metadata som IP-adress, vilket gör det möjligt att identifiera individer även utan direkta personuppgifter.

Måste vi alltid göra en DPIA när vi använder ChatGPT?

En DPIA krävs vid högrisksbehandling av känsliga uppgifter eller storskalig användning, men en grundläggande riskanalys bör alltid genomföras innan AI-tjänster implementeras i verksamheten.

Vad krävs om ChatGPT-tjänsten lagrar data utanför EU?

Vid tredjelandsöverföring krävs SCC och kompletterande TIA efter Schrems II. ChatGPT Enterprise erbjuder EU-dataresidens som ett alternativ för att minska dessa risker.